На днях Toyota представила робота, который носит предметы подобно человеку – прижав к груди. А американская компания Figure похвасталась гуманоидами из железа, автономно работающими на складе. Тем временем в мире ежегодно фиксируются случаи нападения роботов на людей. Последний, трагический, произошёл в конце 2023 года в Корее. Случайность это или мир стоит на пороге восстания машин, «Газете о России» рассказали эксперты.

«Наша цивилизация пока ещё человеческая»

Нападения роботов на людей всё чаще отмечаются в мире. Так, на фабрике по производству автомобилей Tesla в Техасе механизированный помощник вонзил свои железные клещи в спину и руку работнику. Инцидент произошёл два года назад, но компания сообщила о нём лишь в декабре прошлого года. В июне в Британии на прохожего и его собаку напал робот-курьер. Электронный доставщик врезался в пса, после чего принялся методично атаковать ногу хозяина. А минувшей осенью в Южной Корее коллаборация робота и человека стоила жизни последнему: машина, сортировавшая коробки с овощами, вдруг схватила одного из работников за руку и расплющила на конвейерной ленте.

Известный российский писатель-фантаст Вадим Панов уверен, что перечисленные случаи – не повод для паники, поскольку речь идёт о банальных сбоях программы.

– Программное обеспечение для роботизированных устройств пока несовершенно, но, думаю, работа над этим ведётся, – отметил он.

При этом перспективу использования гражданских разработок в робототехнике для военного производства писатель считает весьма актуальной, и знаменитые три закона Азимова здесь ничем не помогут. Просто потому, что производители не будут их соблюдать.

– Помните цитату Станислава Лема? «Всё, что может быть использовано как оружие, будет использовано как оружие». И даже если группа романтиков предложит не использовать роботов в качестве оружия, они будут использованы соотечественниками этих романтиков. Та же Boston Dynamics и прочие с удовольствием продадут своё оборудование Пентагону и даже не задумаются об этике, – подчеркнул Вадим Панов.

Он напомнил, что в январе этого года компания-разработчик нейросети семейства GPT отказалась от запрета на использование её продукта в военных целях. Тем временем в Пентагоне создана оперативная группа для изучения применения генеративного искусственного интеллекта для военных нужд.

При этом писатель уверен: разработчики никогда не выпустят ИИ из-под контроля.

– Не для того разрабатывают искусственный интеллект, чтобы потерять над ним управление. Наша цивилизация – пока ещё человеческая, и человек в ней на первом месте. Кроме того, будем откровенны: грохнуть любую программу – решаемая задача, – подчеркнул он.

Чтобы сценарий восстания машин из вселенной «Терминатора» стал реален, нужно, чтобы роботы и искусственный «Скайнет» контролировали абсолютно всю систему своего обеспечения.

– Они должны уметь управлять электростанциями, ремонтировать их и строить новые. Возможно, им придётся научиться добывать уголь для этих электростанций, менять ветрогенераторы. Вот когда сформируется цепочка обеспечения всего роботизированного добра электроэнергией, тогда мы и вернёмся к этому вопросу. Потому что сейчас любое восстание машины закончится тем, что её выдернут из розетки и переформатируют жёсткий диск, – резюмировал Панов.

Лишняя «деталь»

И всё же, по мнению некоторых экспертов, проблема быстрого развития искусственного интеллекта – гораздо актуальней, чем кажется на первый взгляд.

Ещё несколько лет назад основатель SpaceX и Tesla Илон Маск заявил, что искусственный интеллект является самой серьёзной угрозой, с которой сталкивалась человеческая цивилизация.

– В сфере искусственного интеллекта у меня есть доступ к самым передовым технологиям. И я думаю, что людям есть о чём беспокоиться, – сказал он во время своего выступления перед Национальной ассоциацией губернаторов США.

Российский программист, спроектировавший оригинальную операционную систему «Фантом», основавший группу компаний DZ Systems и создавший «Яндекс Маркет» Дмитрий Завалишин считает, что стремительное развитие искусственного интеллекта действительно может принести человечеству проблемы в будущем. Связаны эти проблемы не со злонамеренностью искусственного интеллекта, ведь наличие у него каких-либо намерений – вопрос неочевидный. Бояться надо другого, считает эксперт.

– Все эти системы активно используются как инструмент построения оптимизационных циклов. К примеру, возьмём систему, которая оптимизирует работу таксопарка, анализируя качество работы водителей и количество автомобилей. Так вот, по отношению к человеку эта система будет не злонамеренна, но абсолютно безэмоциональна. Она будет продавливать своё решение по оптимизации, не озадачиваясь вопросом, насколько это этично с точки зрения человека, – говорит Завалишин.

Вторая проблема, по словам программиста, заключается в том, что система на базе ИИ на сегодняшний день человеком не осмыслима. Масштабы аналитических усилий нейросети превосходят возможности человеческого интеллекта.

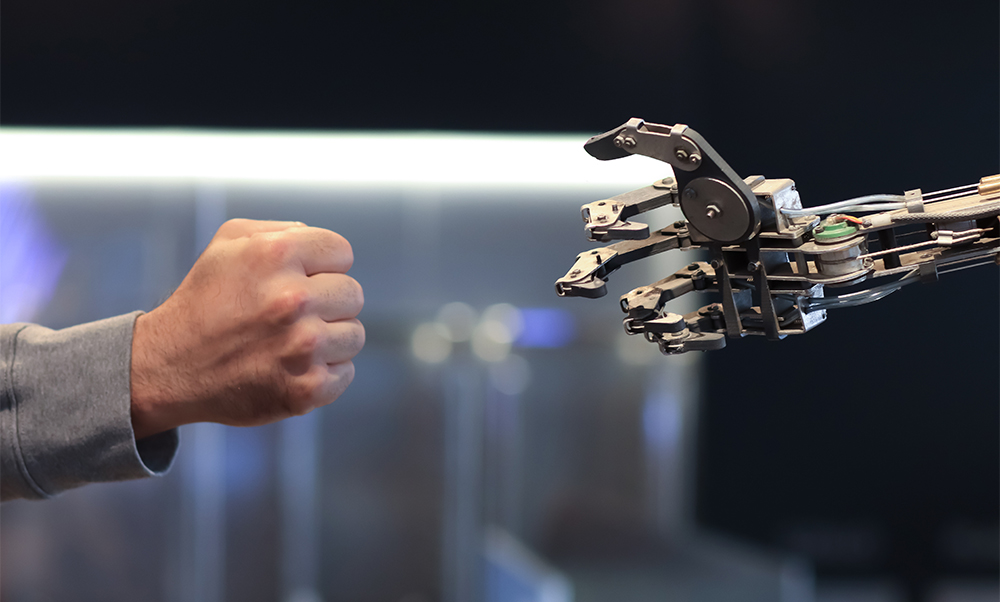

– В силу этого мы не можем ответить на вопрос, а правильно ли и хорошо ли системы искусственного интеллекта себя ведут. На основании поставленных нами задач и целей могут возникнуть вторичные цели и задачи, в рамках одной из которых уничтожение человечества будет побочным позитивным эффектом, – поясняет он.

К примеру, есть изначально безобидная цель – создать наиболее результативный бизнес на планете. И в цикле решения этой задачи люди могут оказаться самой неэффективной, лишней деталью. А значит, их нужно как минимум исключить из процесса, а как максимум – уничтожить.

– Беда не в том, что такой сценарий может родиться как результат вполне себе благих целей, а в том, что мы не в состоянии выявить такие промежуточные цели и правильно их мониторить, – подчёркивает Завалишин.

«Проблема ближе, чем кажется»

Пока эти риски для человечества не особенно актуальны, однако всё может измениться, ведь передача систем под управление ИИ идёт очень быстро, предупреждает Завалишин. Если ещё несколько лет назад занимались всего лишь экспериментами, то теперь это уже типовые сценарии для коротких циклов управления, включающие в себя часть бизнеса компании или отдельный бизнес-процесс.

– Со временем всё более крупные бизнес-процессы будут передаваться под управление ИИ, и вот там эта проблема может оказаться ближе, чем мы ожидаем. А если учесть, что никаких трёх законов робототехники Азимова в военных системах нет и не будет, а ИИ там уже применяется, вопрос замыкания между собой систем с крупным целеполаганием и систем, способных нанести вред человеку, становится всё реальней, – считает Завалишин.

Чтобы такой сценарий не мог воплотиться в жизнь, учёные уже сейчас ищут возможности для подстраховки. Например, как сообщает портал PlayGround.ru, исследователи Кембриджского университета предложили оснащать ИИ «экстренными выключателями», чтобы избежать восстания. Соответствующая статья размещена на сайте университета. Среди авторов исследования – профессора Оксфордского университета и разработчики из Open Ai.

Тем не менее, несмотря на все опасения, связанные с распространением ИИ, без него уже невозможно дальнейшее развитие передовых стран.

Отметим, что президент Владимир Путин в Послании Федеральному собранию 29 февраля призвал к цифровому суверенитету России в области искусственного интеллекта. Он подчеркнул, что нашей стране необходимо усилить работы в области ИИ, чтобы сохранить конкурентоспособность на мировом рынке и обеспечить прорыв в экономике и социальной сфере.

Ксения Стеценко